Ученый преобразует мыслительные образы людей в текст, используя применение «мысленных субтитров».

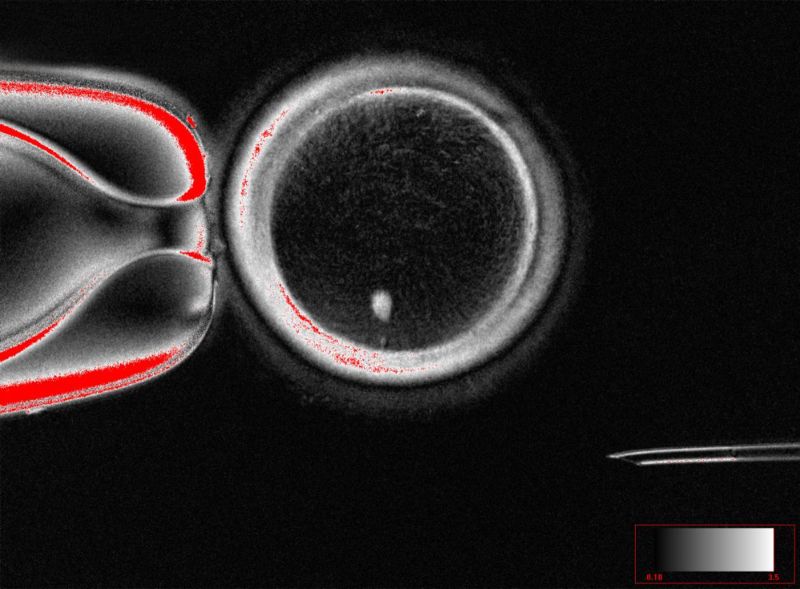

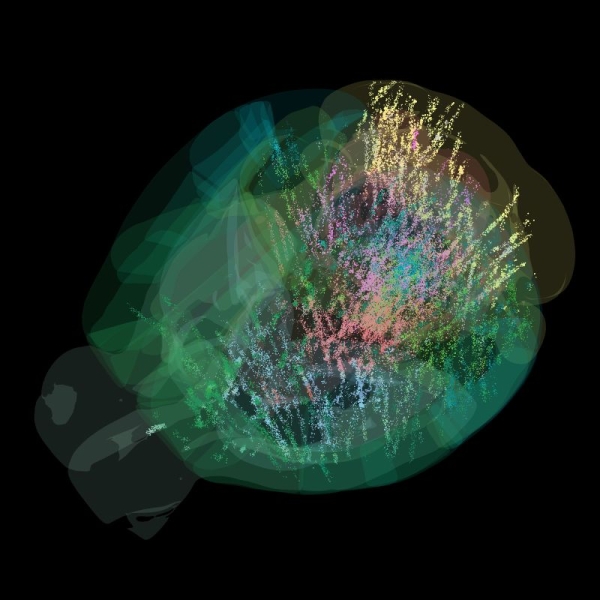

Функциональная магнитно-резонансная томография (ФМРТ) — это неинвазивный метод измерения мозговой активности. На этом снимке МРТ показала несколько горизонтальных изображений мозга, которые можно настроить вверх.

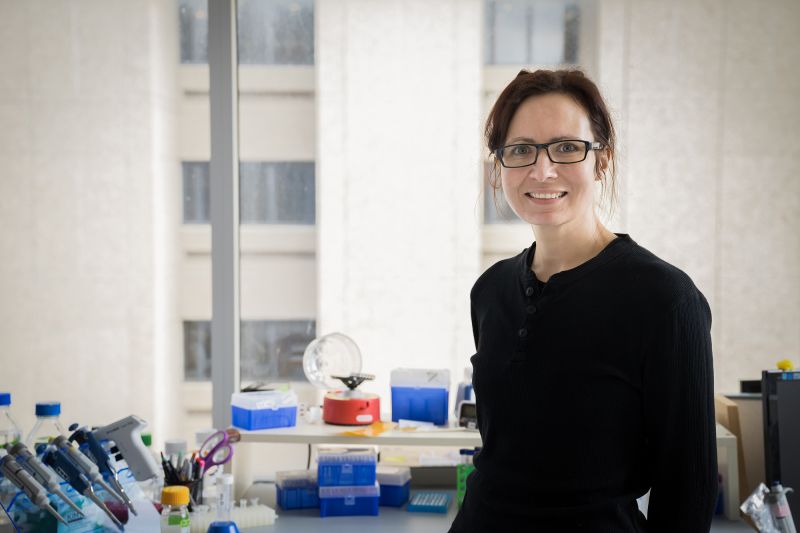

Ссылка скопирована! Ученый из Японии разработал методику, которая использует сканеры мозга и искусственный интеллект для преобразования мыслительных образов человека в точные, описательные предложения. По словам Томоясу Хорикавы, автора исследования, опубликованного 5 ноября в журнале Science Advances, несмотря на прогресс в использовании быстрой мозговой активности для перевода слов, которые мы думаем, в тексте, преобразование наших простых мыслительных образов в язык оказалось стандартным. Однако новый метод Хорикавы, известный как «создание мысленных субтитров», работает с использованием искусственного интеллекта для создания текста, который отражает информацию в мозгу о визуальных деталях, таких как объекты, места, действия и события, а также о том, как они выглядят. отношения между ними. Хорикава, исследователь Лаборатории коммуникационных наук телекоммуникационной компании NTT, расположенная недалеко от Токио, начала анализ мозговой активности четырех мужчин и двух женщин, носителей японского языка в возрасте от 22 до 37 лет, сканируя их мозг во время просмотра видеоклипов. Участники просмотрели 2180 видеороликов без звука, которые длились несколько секунд и существовали по содержанию объектов, сцен и действий.

Большие языковые модели — генерирующие системы искусственного интеллекта, обученные на больших наборах данных, — брали присоединение к этим видеоклипам и преобразование в последовательные числа. Хорикава обучила разработке более простых моделей искусственного интеллекта, изобретенных как «декодеры», которые обеспечивают сканированную мозговую активность, связанную с видеоклипами, с числовыми последовательностями. Затем он использовал декодеры для исследования активности участников мозга, в то время как смотрел или вспоминал видеоролики, в которых ИИ не сталкивался с процессом обучения. Был создан еще один алгоритм для последовательной генерации последовательных слов, которые формируют таким образом индексы расшифрованной активности мозга. По мере того, как искусственный интеллект извлекал уроки из полученных данных, инструмент «описательный текст» становился все лучше и лучше в использовании результатов искусственного интеллекта для описаний видеороликов, которые смотрели участники. «Это всего лишь еще один шаг вперед в том направлении, что, на мой взгляд, мы с полным правом можем назвать взгляд «чтением мозгов», — говорит Марчелло Иенка, профессор этики искусственного интеллекта и нейронаук в Мюнхенском техническом университете в Германии и избранный президентом Международного общества нейроэтики, — сообщил CNN.

Потенциал для «глубоких» медицинских вмешательств.

Текст модели искусственного интеллекта написан на английском языке, хотя участники не были носителями английского языка. По словам Хорика, этот метод позволяет создавать алгоритмические описания визуального контента даже без использования активности в областях мозга, связанных с языком, или «языковой сетью», что указывает на то, что этот метод можно использовать, даже если у кого-то есть повреждение в этой языковой сети. Согласно исследованию, технология может быть использована для оказания помощи людям с афазией, которые испытывают трудности с речевым самовыражением из-за повреждения языковой сети; или боковым амиотрофическим склерозом (БАС), прогрессирующим нейродегенеративным заболеванием, которое влияет на речь. «Я думаю, что это исследование открывает путь к некоторому вмешательству в общество для людей, испытывающих трудности в общении, включая невербальных аутистов», — сказал психолог Скотт Барри Кауфман, преподаватель колледжа Барнард в Нью-Йорке, который не принимал участия в обучении.

«Главная проблема конфиденциальности»

Успех этого метода, который может быть применен для расшифровки мыслей младенцев или животных, а также содержания сновидений, «поднимает эти проблемы» в отношении конфиденциальности, поскольку существует возможность раскрытия мыслей человека до того, как он их озвучивает, наблюдения в поведении. Если в будущем эта технология будет использоваться пользователями не только в биомедицинских целях, «я думаю, это станет серьезной проблемой для конфиденциальности», — сказала Иенка. Он добавил, что есть много компаний, таких как Neuralink, стартап Илона Маска по внедрению мозговых имплантатов, которые публично заявляют о скором создании нейронных имплантатов для населения в целом. «Если мы добьемся этого, то нам следует соблюдать очень, очень строгие правила, когда речь заходит о предоставлении доступа к сознанию и мозгу людей», — сказала Иэнка, отметив, что наш мозг содержит «конфиденциальную информацию», такую как «признаки ранней слабоумия и психических заболеваний и депрессий».

Исследование, опубликованное в журнале Cell в августе, показало, что «утечку» личных мыслей во время декодирования можно предотвратить с помощью механизма, при котором пользователь думает о конкретном ключевом слове, чтобы разблокировать инструмент декодирования только по назначению. «Нейронаука развивается быстрыми темпами, и вспомогательный потенциал огромен, но защита психической неприкосновенности и свобода мысли не могут ждать», — сказал социолог Лукаш Шошкевич, доцент Университета Адама Мицкевича в Польше и директор по поисковым запросам Фонда Neurorights в Нью-Йорке. Йорк.

«Мы должны по умолчанию передавать нейронные данные как конфиденциальным, требовать явного соглашения, ограниченных лиц и отдавать приоритет обработки на устройстве с использованием функций разблокировки, контролируемых пользователем. Зависимость от ИИ порождает дополнительные проблемы в области контроля и кибербезопасности и требует необходимости создания оснований, специфичных для ИИ», — сказал CNN Шошевич, который не участвует в обращении.

Однако Хорикава отметила, что метод, используемый в его разработке, требует большого объема данных по сбору данных в стране с активными участниками. Таким образом, хотя эта технология полезна для нейробиологических исследований, она «не столь точна для практического использования», — сказал он. Кроме того, видеозаписи, используемые в обучении, включают типичные сцены, например, когда собака кусает человека, но не более необычные сцены — скажем, когда мужчина кусает собаку. Поэтому пока неясно, можно ли использовать этот метод получения для менее доступных мыслительных образов. В результате, «хотя некоторые люди могут опасаться, что эта технология представляет собой серьезное нарушение психической неприкосновенности», на самом деле «нынешний подход не позволяет легко прочитать личную мысль человека», — сказала Хорикава.

Образ жизни, который вдохновляет! Советы, идеи и тренды для здоровья, комфорта и гармонии каждый день.